AI-এর উপর কতটা নিয়ন্ত্রণ জরুরি? কী বলছেন বিজ্ঞানীরা?

AI-এর উপর কতটা নিয়ন্ত্রণ জরুরি? কী বলছেন বিজ্ঞানীরা?

9 April 2026 , 01:27:16 pm

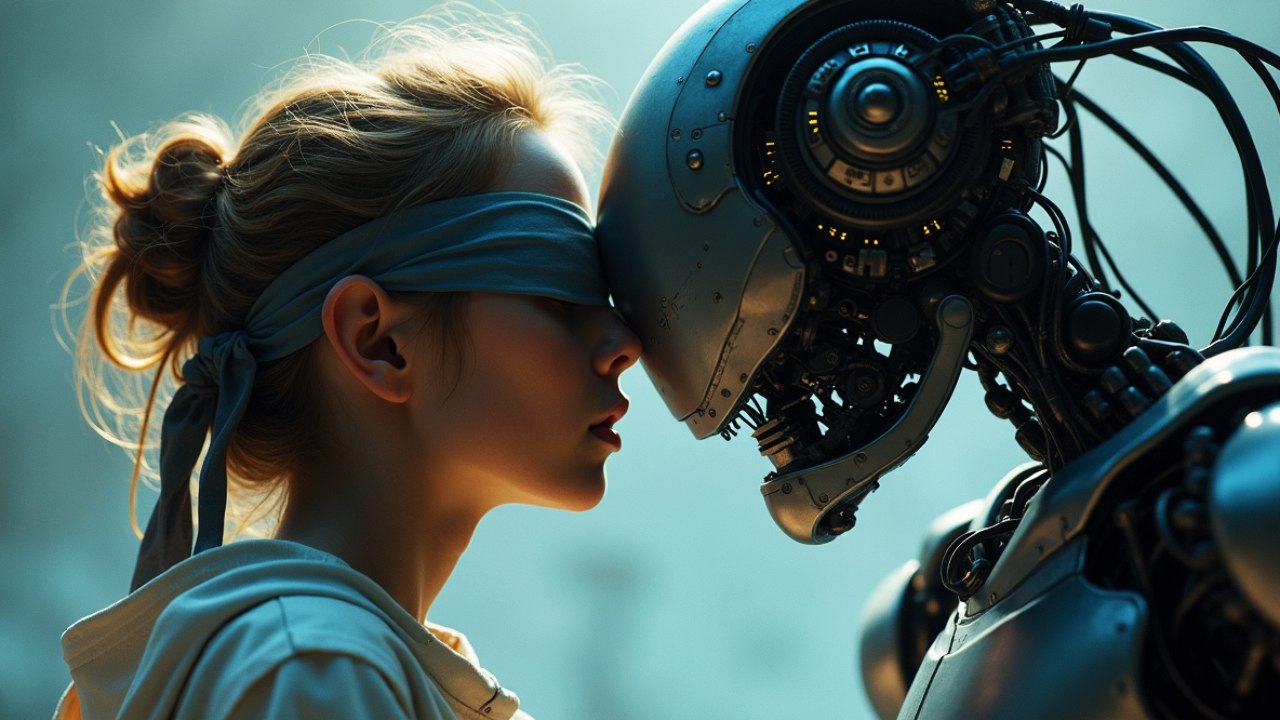

কৃত্রিম বুদ্ধিমত্তা বা AI আজ প্রযুক্তির দুনিয়ায় বিপ্লব ঘটিয়েছে। লেখা তৈরি করা থেকে ছবি বানানো, তথ্য বিশ্লেষণ থেকে জটিল সমস্যার সমাধান- প্রায় সব ক্ষেত্রেই AI ব্যবহার হচ্ছে। কিন্তু এই দ্রুত অগ্রগতির সঙ্গে সঙ্গে উঠে এসেছে একাধিক নৈতিক ও আইনি প্রশ্ন। AI যদি কপিরাইট লঙ্ঘন করে, তার দায় কার? ট্রেনিং ডেটার পক্ষপাত (bias) কি AI-এর উত্তরেও প্রভাব ফেলে? আর AI যদি আত্মবিশ্বাসের সঙ্গে ভুল তথ্য দেয়, তবে তার প্রভাব কতটা বিপজ্জনক হতে পারে?

AI গবেষকদের মতে, এই সমস্যার মূল সূত্র লুকিয়ে আছে ট্রেনিং ডেটা-র মধ্যেই। ইন্টারনেট থেকে সংগ্রহ করা বিপুল পরিমাণ ডেটার মধ্যে যেমন ভালো তথ্য থাকে, তেমনই থাকে গালিগালাজ, আক্রমণাত্মক ভাষা বা জাতি-লিঙ্গভিত্তিক পক্ষপাত। সেই ডেটা দিয়ে মডেল প্রশিক্ষণ হলে AI-এর উত্তরেও একই ধরনের পক্ষপাত দেখা দিতে পারে। ফলে প্রযুক্তির নিরপেক্ষতা নিয়ে প্রশ্ন উঠছে।

আরেকটি বড় বিতর্ক কপিরাইট নিয়ে। AI মডেল তৈরি করতে বিপুল পরিমাণ ওয়েবসাইট, বই বা লেখার ডেটা ব্যবহার করা হয়। কিন্তু প্রতিটি লেখকের কাছ থেকে আলাদা করে অনুমতি নেওয়া প্রায় অসম্ভব। ফলে প্রশ্ন উঠছে- এই ডেটা ব্যবহার কি আইনসম্মত? আবার AI যদি সেই ডেটার ভিত্তিতে নতুন লেখা তৈরি করে, তবে মূল লেখকের অধিকার কোথায় দাঁড়ায়?

এর সঙ্গে রয়েছে 'hallucination' নামের আরেক সমস্যা। অনেক সময় AI আত্মবিশ্বাসের সঙ্গে ভুল তথ্যও দিয়ে বসে। ব্যবহারকারী যদি সেই তথ্য যাচাই না করেন, তবে ভুল সিদ্ধান্ত বা বিভ্রান্তির সম্ভাবনা তৈরি হতে পারে।

এই সব সমস্যার সমাধানে বিভিন্ন দেশ ভিন্ন পথ নিচ্ছে। ইউরোপে GDPR-এর মতো কঠোর ডেটা সুরক্ষা আইন রয়েছে, যা ব্যক্তিগত তথ্য ব্যবহারে কঠোর নিয়ন্ত্রণ আরোপ করে। অন্যদিকে যুক্তরাষ্ট্র তুলনামূলকভাবে নমনীয় নীতি অনুসরণ করছে, যাতে প্রযুক্তিগত উদ্ভাবন দ্রুত এগোতে পারে।

ভারত অবশ্য এই দুই মডেলের মাঝামাঝি পথ খুঁজছে- যাতে একদিকে প্রযুক্তির সুবিধা পাওয়া যায়, অন্যদিকে নৈতিক ঝুঁকিও নিয়ন্ত্রণে থাকে।

বিশেষজ্ঞদের মতে, AI প্রযুক্তি এত দ্রুত এগোচ্ছে যে আইন ও নীতিনির্ধারণ সেই গতির সঙ্গে তাল মেলাতে পারছে না। তাই ভবিষ্যতে AI-এর নিরাপদ ও ন্যায়সঙ্গত ব্যবহার নিশ্চিত করতে সতর্ক নীতি, গবেষণা ও আন্তর্জাতিক সহযোগিতা অত্যন্ত গুরুত্বপূর্ণ হয়ে উঠবে।